Paso 6: Programación de sensores de visión 3D con R.O.S y Python

En este paso, vamos a ver como interfaz un sensor de visión 3D como Kinect / Asus Xtion Pro en R.O.S.

Podemos instalar a controlador del sistema de sensor 3D, middleware llamado OpenNI y sus archivos de controlador/lanzamiento R.O.S usando el siguiente comando

Después de instalar el controlador, puede iniciar 3D sensor usando el siguiente comando

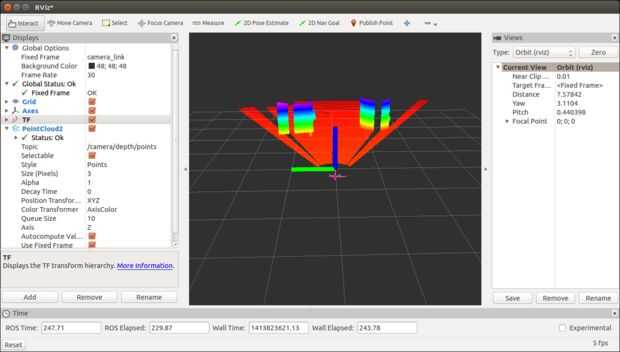

Podemos ver la nube de puntos 3D sensor en Rviz utilizando las siguientes comando. Se puede ver la nube de puntos de pantalla de visualización de la galería de imágenes

Estamos utilizando el sensor 3D para burlarse de la funcionalidad de escáner de láser que utiliza para realizar el golpe. El escáner láser es muy caro, así que imitando las funciones de escáner de láser con sensor de visión 3D puede reducir el presupuesto global del robot.

Los datos de nube de puntos generados no por el sensor 3D pero se procesan en el controlador de openni ROS.

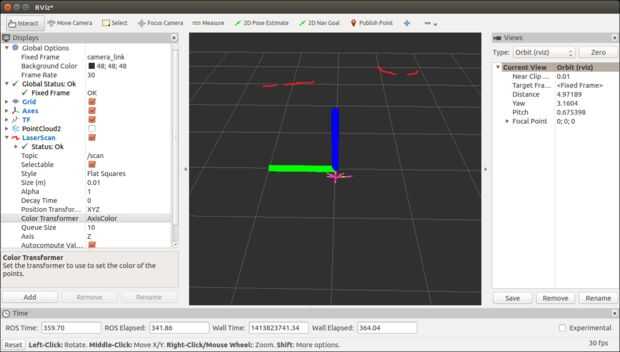

Los datos de nube de puntos se puede convertir al laser scanner datos utilizando el siguiente paquete ROS

Conversión de nube de puntos a datos de escáner láser

La depthimage_to_laserscan y pointcloud_to_laserscan paquetes de ayuda a convertir la imagen de profundidad del sensor 3D para datos de escaneo por láser.

Puedes ver las imágenes de la nube de puntos se puede convertir a la exploración de la galería de imágenes con láser